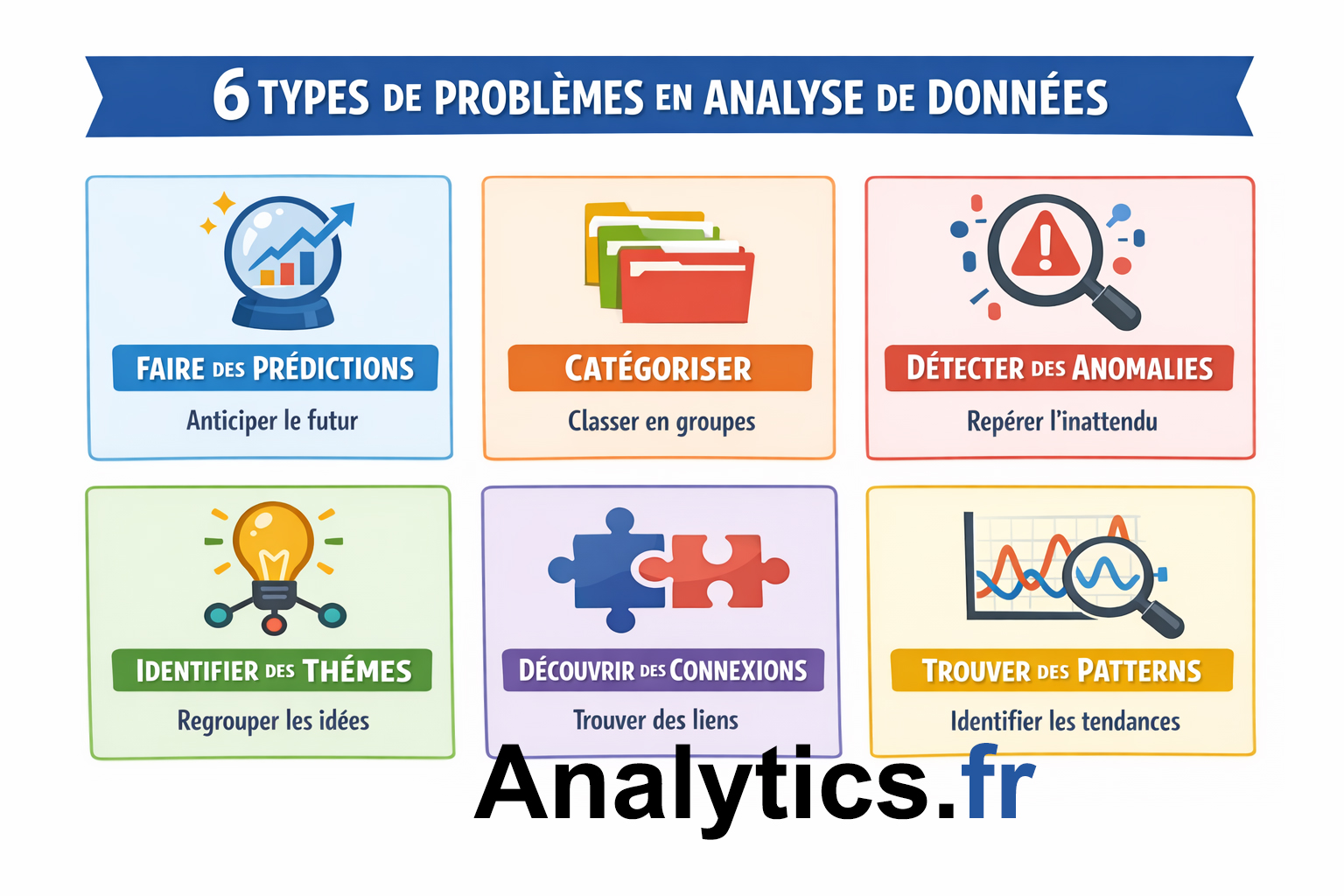

6 types de problèmes en data analyse : schéma simple à retenir

Points abordés dans cet article

- Pourquoi les problèmes sont-ils au cœur de l’analyse de données ?

- Faire des prédictions (Making predictions)

- Catégoriser (Categorizing things)

- Détecter des anomalies (Spotting something unusual)

- Identifier des thèmes (Identifying themes)

- Découvrir des connexions (Discovering connections)

- Trouver des patterns / tendances (Finding patterns)

- Conclusion : le fil rouge des six problèmes

- FAQ (Foire aux questions)

- Lexique

Mis à jour le 4 mars 2026

Pourquoi les problèmes sont-ils au cœur de l’analyse de données ?

Nous vivons à une époque où les données sont partout : capteurs connectés, réseaux sociaux, transactions bancaires, dossiers médicaux, images et vidéos… Chaque clic et chaque mesure produisent un océan de données qui peuvent sembler intimidantes. Pourtant, pour les entreprises et les organisations, cette profusion de données n’a de valeur que si on peut en extraire du sens. C’est là qu’intervient l’analyste de données, spécialiste capable de transformer l’information brute en connaissances utiles et en actions pertinentes.

À première vue, cela peut sembler abstrait : collecter et trier des chiffres ou créer des graphiques. Mais en réalité, l’analyste de données est un résolveur de problèmes. Chaque mission commence par une question ou une difficulté à laquelle il faut répondre. L’analyste doit d’abord clarifier le problème : est‑ce que l’on cherche à prévoir l’évolution d’un phénomène ? À distinguer des groupes d’utilisateurs ? À repérer des comportements anormaux ? Une fois le problème défini, l’analyste déploie ses compétences statistiques, sa curiosité et sa créativité pour trouver des réponses.

Dans cet article, nous allons explorer les six grandes catégories de problèmes que l’on rencontre en data analysis. Pour chacune d’elles, nous expliquerons les concepts clés, proposerons des exemples concrets et donnerons des pistes méthodologiques. Nous illustrerons également les sections avec des images représentant des analystes de données, pour vous aider à visualiser l’ambiance de ces tâches souvent fascinantes.

Faire des prédictions (Making predictions)

Qu’est-ce qu’une prédiction ?

Faire des prédictions à partir de données consiste à utiliser des informations historiques ou en temps réel pour estimer ce qui va se passer dans le futur. La prédiction est au cœur du domaine appelé analytique prédictive, qui combine statistiques, machine learning et algorithmes pour anticiper des tendances ou des événements à venir. Selon une analyse de Harvard Business School, l’analytique prédictive utilise des données passées pour prédire des tendances futures et optimiser la prise de décision. Cette approche permet d’anticiper des évolutions et d’ajuster les stratégies en conséquence.

Comment ça marche ?

L’analytique prédictive s’appuie sur différents outils :

-

Les séries chronologiques, qui analysent des données récoltées à intervalles réguliers (ventes quotidiennes, température hebdomadaire, fréquentation mensuelle, etc.). Elles permettent de déceler des tendances et de prévoir l’évolution future.

-

Les modèles de régression, qui établissent des relations entre une variable à prédire et un ensemble de facteurs explicatifs (par exemple, l’âge, le revenu ou la météo). Un article de Harvard Business School rappelle que les régressions linéaires et logistiques sont couramment utilisées pour construire des modèles prédictifs et interpréter l’impact des variables.

-

Les algorithmes de machine learning, comme les forêts aléatoires, les réseaux neuronaux et les méthodes de gradient boosting. Ces méthodes apprennent les patterns complexes présents dans les données pour faire des prédictions robustes.

Exemple concret : prédire des problèmes de santé

Imaginez un hôpital qui souhaite réduire les hospitalisations de patients souffrant de maladies chroniques. Chaque patient transmet quotidiennement ses données de santé (tension artérielle, glycémie, poids, etc.) via des appareils connectés. L’hôpital combine ces données avec l’âge des patients, leurs antécédents médicaux et leurs facteurs de risque. Grâce à un algorithme prédictif, il est possible de détecter en amont les signes de complications : si un patient présente un risque de crise cardiaque ou d’hypoglycémie, l’équipe médicale est alertée et peut intervenir à distance ou organiser une consultation. Ce type d’application illustre la capacité de l’analytique prédictive à sauver des vies tout en optimisant les ressources hospitalières.

Autres applications

-

Prévisions financières : prédire la rentabilité d’un investissement ou le cours d’une action en croisant l’historique de prix, le volume d’échanges et des variables macroéconomiques.

-

Maintenance préventive : anticiper une panne d’équipement en surveillant les vibrations, la température et l’usure de pièces. Une analyse de Harvard Business School souligne que ces modèles permettent de prévenir des incidents dans l’industrie avant qu’ils se produisent.

-

Marketing ciblé : estimer les chances qu’un client réponde à une promotion en fonction de ses achats passés, de son comportement en ligne et de données démographiques.

En résumé

Faire des prédictions, c’est transformer l’incertitude en probabilité. L’analyste de données se pose la question : « Que va‑t‑il se passer si rien ne change ? Et si nous intervenons maintenant ? » Les modèles de prédiction permettent ensuite d’orienter des actions avant que les événements ne se produisent. C’est une approche puissante qui demande rigueur, sens critique et conscience des limites (par exemple, ne pas surestimer ses modèles ou oublier que des changements inattendus peuvent survenir).

Catégoriser (Categorizing things)

Pourquoi catégoriser ?

Lorsque vous gérez un grand volume de données, la première étape pour y voir clair est souvent de classer ces données en groupes homogènes. La catégorisation consiste à assigner chaque élément à un groupe selon ses caractéristiques communes, afin de faciliter l’analyse et l’interprétation. Selon ShinyDocs, la catégorisation organise les données en fonction de critères pour améliorer la recherche et l’accessibilité. Ce regroupement simple rend les ensembles de données plus intelligibles et permet de prioriser les actions.

Comment classer les données ?

Il existe plusieurs méthodes pour catégoriser :

-

Classification hiérarchique : elle construit un arbre (ou dendrogramme) où chaque branche est un groupe de données. On commence par considérer chaque donnée comme un groupe distinct, puis on fusionne successivement les groupes qui se ressemblent le plus jusqu’à obtenir une structure hiérarchique.

-

K-means : cet algorithme répartit les données en k groupes, en minimisant la distance entre chaque donnée et le centre de son groupe. On fixe k à l’avance et on obtient des clusters plus ou moins équilibrés selon la distribution des données.

-

*Clustering hiérarchique vs partitif : dans l’approche hiérarchique, l’analyste n’a pas forcément besoin de définir un nombre fixe de groupes ; au contraire, l’approche partitive impose un nombre déterminé de catégories.

Exemple concret : regroupement d’employés dans une usine

Dans une entreprise de fabrication, la direction souhaite optimiser la formation et l’affectation des employés. Pour cela, elle collecte des données sur les performances dans plusieurs tâches : ingénierie, assemblage, réparation et maintenance. Un data analyste propose de segmenter les employés en groupes selon leur efficacité dans chaque tâche. Les plus performants en ingénierie sont regroupés, ceux en maintenance sont identifiés comme experts… Grâce à ce clustering, l’entreprise peut organiser des formations ciblées pour les employés en difficulté et reconnaître la valeur des équipes les plus performantes. L’analyse peut même être enrichie par des variables démographiques (ancienneté, service), afin de personnaliser encore plus les recommandations.

Nuances entre catégorisation et classification

La terminologie peut prêter à confusion. ShinyDocs distingue la catégorisation, qui vise à organiser l’information en unités simples pour la gestion et la recherche, de la classification, qui est utilisée pour des questions de conformité et de sécurité. Quant à GeeksforGeeks, la classification désigne l’organisation systématique des données en groupes ou catégories pour en faciliter l’analyse. Dans la pratique, ces termes peuvent se recouvrir ; l’important est de comprendre l’objectif du regroupement et d’utiliser la méthode adaptée.

En résumé

Catégoriser, c’est mettre de l’ordre dans le chaos. Face à un flux massif d’informations, l’analyste crée des catégories pour rendre les données exploitables. Ce travail de segmentation est crucial pour passer à l’étape suivante : l’analyse approfondie. Sans classification préalable, le risque est de se noyer dans les détails et de passer à côté des signaux importants.

Détecter des anomalies (Spotting something unusual)

Qu’est-ce qu’une anomalie ?

Une anomalie est un point de données ou un événement qui dévie du comportement normal d’un système ou d’un ensemble de données. Détecter des anomalies signifie repérer ces occurrences inhabituelles, afin de les comprendre ou d’y réagir. Splunk, spécialiste de l’analyse de données en temps réel, explique que l’anomalie detection identifie des données qui s’écartent de la norme et peut révéler une fraude, un incident de sécurité ou une défaillance d’équipement. Les anomalies peuvent être :

-

Globales (point anomalies) : un point isolé qui diffère nettement du reste (par exemple, une transaction de 10 000 € sur un compte où la moyenne est de 30 € par transaction).

-

Contextuelles : elles sont inhabituelles dans un contexte donné mais pas nécessairement en valeur absolue (ex. une heure supplémentaire payée à minuit pour un employé qui travaille habituellement de jour).

-

Collectives : une séquence de points qui semble normale individuellement mais déviante lorsqu’on la considère comme un ensemble (ex. plusieurs petits retraits successifs sur un compte bancaire).

Méthodes de détection

Les approches de détection des anomalies peuvent être statistiques (écarts-types, distances, quantiles), basées sur l’apprentissage automatique (isolation forest, one-class SVM), ou encore sur des réseaux neuronaux (auto-encodeurs). Splunk souligne que ces méthodes permettent de repérer la fraude, de prévenir les menaces de sécurité et d’éviter les pannes. Il est également important de choisir des seuils adaptés pour minimiser les faux positifs (alarmes injustifiées) et les faux négatifs (anomalies manquées).

Exemple concret : hausse de 30 % des inscriptions dans une école

Une école publique remarque soudainement une hausse de 30 % des inscriptions à la rentrée par rapport aux années précédentes. Cette augmentation est inattendue et les infrastructures sont dimensionnées pour un nombre limité d’élèves. Un analyste enquête et constate que plusieurs nouveaux immeubles d’appartements ont été construits dans le district au cours des six derniers mois. Cette évolution démographique explique l’anomalie. L’analyse permet à la direction d’anticiper l’afflux d’élèves : ils recrutent des enseignants et préparent des salles supplémentaires afin de maintenir la qualité de l’enseignement.

Autres applications

-

Détection de fraude bancaire : repérer des transactions atypiques pour bloquer des paiements suspects.

-

Surveillance réseau : identifier des activités anormales (pics de trafic, connexions inhabituelles) pour réagir rapidement en cas d’intrusion.

-

Contrôle qualité : détecter des défauts de production dans une chaîne industrielle afin de stopper une série défectueuse dès les premiers signaux..

En résumé

Détecter des anomalies revient à trouver l’aiguille dans la botte de foin. Dans une mer de données, l’analyste repère ce qui ne correspond pas aux attentes, ce qui cloche. C’est un travail sensible qui demande de définir avec soin ce qui est « normal » et d’utiliser des outils capables de détecter des écarts parfois subtils. L’objectif est souvent d’agir rapidement : prévenir une fraude, corriger un dysfonctionnement ou comprendre un changement brutal.

Identifier des thèmes (Identifying themes)

À quoi servent les thèmes ?

Dans l’analyse qualitative, identifier des thèmes consiste à regrouper plusieurs observations ou catégories en concepts plus larges. Cette approche est couramment utilisée pour traiter des données textuelles (interviews, comptes rendus, réseaux sociaux), afin de faire émerger des sujets récurrents et de comprendre les perceptions des personnes. La méthodologie de thématique ou thematic analysis est un processus en six étapes : se familiariser avec les données, générer des codes initiaux, rechercher des thèmes, les examiner, les définir et les nommer, et enfin produire le rapport final. Cette démarche permet de transformer une masse d’informations en insights exploitables.

Comment mener une analyse thématique ?

-

Immersion dans les données : l’analyste lit et relit les textes (transcriptions d’entretien, commentaires clients, réponses à une enquête) pour se familiariser avec leur contenu. Il note ses premières impressions.

-

Codage : il attribue des codes (étiquettes) à des passages de texte qui représentent des idées intéressantes. Par exemple, dans une enquête sur le télétravail, les codes pourraient être « flexibilité », « isolement », « productivité ».

-

Recherche des thèmes : il regroupe les codes qui se ressemblent en thèmes plus larges. Par exemple, les codes « flexibilité » et « autonomie » pourraient former le thème « liberté de travailler à son rythme ».

-

Examen et raffinage : il vérifie si les thèmes sont cohérents et pertinents par rapport à la question de recherche. Certains peuvent être fusionnés, d’autres divisés.

-

Définition et dénomination : il décrit chaque thème de manière claire et choisit un nom reflétant son essence.

-

Rédaction du rapport : il illustre chaque thème avec des extraits de données et explique comment les thèmes s’articulent entre eux pour répondre à la question posée.

Exemple concret : productivité des employés dans l’usine

Reprenons l’exemple de l’entreprise de fabrication qui souhaite évaluer la performance de ses équipes. Après avoir segmenté les employés par tâches (ingénierie, maintenance, assemblage), l’analyste va plus loin en regroupant les catégories en thèmes de productivité. Il distingue deux grands thèmes : « haute productivité » et « faible productivité ». Ces thèmes regroupent plusieurs variables (respect des délais, erreurs de production, capacité à résoudre des problèmes) et permettent de dresser un portrait global des performances. La direction peut ainsi identifier les meilleurs contributeurs pour les valoriser et repérer ceux qui nécessitent une formation supplémentaire.

En résumé

Identifier des thèmes, c’est donner du sens à des éléments disparates. L’analyste transforme un ensemble de codes ou de catégories en concepts plus larges, afin de comprendre les perceptions et les expériences à travers un prisme plus holistique. C’est une approche indispensable lorsqu’on traite des données qualitatives, car elle permet d’aller au-delà des statistiques pour saisir ce qui motive ou freine les individus.

Découvrir des connexions (Discovering connections)

De quoi parle-t-on ?

Découvrir des connexions, c’est mettre en évidence les relations entre différentes variables, acteurs ou phénomènes. Cette démarche permet de mieux comprendre les interactions et d’identifier des coïncidences significatives. L’outil mathématique le plus connu pour cette tâche est la corrélation, qui mesure la force et la direction de la relation entre deux variables quantitatives. D’après Innerview Analytics, la corrélation aide à identifier des schémas, à prendre des décisions basées sur les données, et à formuler des hypothèses pour des recherches futures. Néanmoins, il est crucial de rappeler que corrélation ne signifie pas causalité : deux variables peuvent évoluer ensemble sans que l’une soit la cause de l’autre.

Principales techniques pour découvrir des connexions

-

Analyse de corrélation (Pearson, Spearman) : elle évalue la relation linéaire ou monotone entre deux variables. L’indice de corrélation varie de −1 à +1 ; plus sa valeur absolue est élevée, plus la relation est forte.

-

Analyse de réseau : elle représente des entités (personnes, entreprises, gènes) comme des nœuds, reliés par des liens qui symbolisent des interactions ou des connexions. Elle permet de détecter des communautés, des nœuds influents et des liaisons cachées.

-

Analyse de causalité : au-delà de la corrélation, certaines méthodes (test de Granger, modèles à variables latentes) tentent d’inférer des relations de cause à effet en se basant sur des données temporelles et des hypothèses.

Exemple concret : chaîne d’approvisionnement d’un scooter

Imaginons une entreprise qui fabrique des scooters. Elle remarque un ralentissement de la production à cause de la qualité des roues. Après enquête, elle découvre que son fournisseur de roues a lui-même des problèmes d’approvisionnement en caoutchouc, car son sous‑fournisseur n’a plus accès aux matières premières. En mettant ces informations en commun, les entreprises comprennent qu’elles partagent un problème global dans la chaîne d’approvisionnement. Elles peuvent ainsi mutualiser leurs efforts : par exemple, en cherchant ensemble un nouveau fournisseur de caoutchouc ou en investissant dans une solution de substitution. Découvrir ces connexions permet à chacun de mieux planifier et d’éviter que des ruptures isolées ne mettent toute la chaîne en danger.

En résumé

Découvrir des connexions, c’est réaliser que nous ne vivons pas dans un monde isolé. Les données peuvent montrer que nos actions ou nos variables sont interconnectées. L’analyste qui identifie ces relations aide à éviter des décisions isolées ou des conclusions hâtives. Cependant, comme le rappelle Innerview Analytics, il faut se garder d’interpréter des corrélations comme des causalités ; un lien statistique n’est qu’un indice, pas une preuve formelle.

Trouver des patterns / tendances (Finding patterns)

Comprendre les patterns

Repérer des patterns (motifs) ou des tendances, c’est l’une des missions les plus fondamentales de l’analyste de données. Cela consiste à identifier des structures récurrentes dans les données, que ce soient des séquences, des oscillations, des cycles ou des régularités spatiales. Selon V7 Labs, le pattern recognition est une branche de l’apprentissage automatique qui cherche à reconnaître des motifs et des régularités dans les textes, les images ou les sons. Ces motifs peuvent ensuite être utilisés pour classer ou regrouper des données en se basant sur des représentations précédentes.

Techniques pour trouver des patterns

-

Analyse de fréquences et transformations : la transformée de Fourier ou l’ondelette permettent de détecter des signaux périodiques dans des séries temporelles (par exemple, des cycles saisonniers ou hebdomadaires). Cette méthode est utile pour identifier des cycles dans la consommation d’énergie ou le trafic internet.

-

Apriori et règles d’association : ces algorithmes trouvent des paires d’achats fréquentes dans les données transactionnelles. Par exemple, on peut découvrir que les clients qui achètent des couches achètent souvent aussi des lingettes.

-

Décomposition de séries temporelles : on décompose une série en trois composantes : tendance (évolution générale), saisonnalité (cycles réguliers) et résidus. Cela permet de voir des changements à long terme.

-

Méthodes de clustering : pour les patterns visuels (images) ou sonores, on classe les objets en groupes selon leurs caractéristiques morphologiques ou spectrales. V7 Labs indique que le pattern recognition comprend la classification et le clustering afin d’assigner de nouveaux objets à des catégories connues.

Exemple concret : habitudes d’achats en ligne

Un site de commerce électronique examine les transactions de ses clients sur plusieurs années. L’analyste observe que les ventes de plats cuisinés en conserve augmentent avant les périodes de tempêtes et que les ventes de gants et bonnets diminuent pendant les mois chauds. Grâce à ces patterns saisonniers, l’entreprise peut ajuster ses stocks pour ne pas manquer d’articles essentiels avant un cyclone ou, à l’inverse, éviter de surstocker des produits de saison en plein été. De plus, l’analyse des associations révèle que les clients qui achètent des laits pour bébé commandent souvent des biberons dans la même semaine, ce qui ouvre la porte à des recommandations personnalisées ou des packs promotionnels.

En résumé

Trouver des patterns revient à faire émerger des structures cachées dans des données parfois chaotiques. L’analyste aide l’entreprise à anticiper les besoins, à optimiser ses ressources et à mieux comprendre le comportement des utilisateurs. De nombreuses méthodes existent, des statistiques classiques au deep learning. Le choix dépend du type de données, du volume et de l’objectif de l’analyse.

Conclusion : le fil rouge des six problèmes

Ces six catégories – faire des prédictions, catégoriser, détecter des anomalies, identifier des thèmes, découvrir des connexions et trouver des patterns – couvrent l’essentiel des problématiques rencontrées par un analyste de données. Chacune demande des compétences et des outils spécifiques :

-

La prédiction nécessite de bonnes connaissances en statistiques et en machine learning, ainsi qu’une conscience de l’incertitude des modèles.

-

La catégorisation fait appel au clustering et à des méthodes permettant de regrouper des données hétérogènes.

-

La détection d’anomalies demande la capacité de définir un comportement normal et d’identifier des écarts, souvent en temps réel.

-

L’identification de thèmes concerne plutôt l’analyse qualitative et implique d’éprouver des données textuelles et d’y faire émerger des concepts.

-

La découverte de connexions utilise des mesures de corrélation ou des graphes pour comprendre les interactions entre variables.

-

La recherche de patterns combine l’analyse de séries temporelles, de séquences et de règles d’association pour dégager des structures répétitives.

Comprendre le type de problème est essentiel pour choisir la bonne approche analytique. Bien souvent, un projet d’analyse de données combine plusieurs de ces catégories : par exemple, on commence par détecter des anomalies, puis on regroupe les cas normaux et anormaux en catégories pour mieux comprendre les différences, et on termine par prédire la probabilité qu’un nouvel événement soit une anomalie. De plus, l’analyste doit garder à l’esprit les limites des méthodes (corrélation ≠ causalité), les biais éventuels et la nécessité d’expliquer clairement ses résultats aux non‑spécialistes.

FAQ (Foire aux questions)

1. Quelle est la différence entre catégorie et thème ?

Une catégorie est un groupe d’éléments qui partagent des caractéristiques communes ; c’est souvent le résultat d’un clustering de données brutes. Un thème, en revanche, est un concept plus large qui regroupe plusieurs catégories ou codes. Par exemple, regrouper des employés selon leur efficacité en ingénierie est une catégorisation ; regrouper les catégories « ingénierie efficace » et « maintenance efficace » en un thème « haute productivité » permet d’avoir une vue globale de la performance.

2. Peut-on utiliser la corrélation pour démontrer la causalité ?

Non. La corrélation mesure la force d’une association entre deux variables, mais elle ne prouve pas que l’une cause l’autre. Un exemple classique est le lien entre la consommation de glace et le nombre de noyades : ils augmentent tous deux en été, mais l’un n’est pas la cause de l’autre. Pour établir la causalité, il faut recourir à des méthodes expérimentales ou à des modèles causaux.

3. Comment définir ce qui est « normal » dans la détection d’anomalies ?

Définir la normalité implique d’analyser l’historique des données et d’identifier des plages acceptables ou des patterns habituels. On peut utiliser des moyennes, des quantiles, des modèles de séries temporelles, ou même entraîner un algorithme à apprendre le comportement normal et à signaler tout écart significatif. La difficulté est de capter la variabilité naturelle tout en repérant ce qui sort réellement de la norme.

4. Quelle est la taille d’échantillon nécessaire pour une analyse fiable ?

Il n’y a pas de réponse universelle, car la taille nécessaire dépend du type d’analyse, du nombre de variables, de la dispersion des données et du niveau de confiance souhaité. En général, plus on dispose de données, plus les conclusions sont robustes. Toutefois, même un petit jeu de données peut fournir des insights, à condition de reconnaître ses limites et d’exprimer l’incertitude.

5. Les modèles prédictifs peuvent-ils être biaisés ?

Oui. Les modèles apprennent à partir des données historiques. Si ces données reflètent des discriminations ou des erreurs systématiques, les modèles peuvent reproduire et amplifier ces biais. Par exemple, un algorithme de recrutement formé sur des données où certains profils sont sous‑représentés risque de moins bien prédire la réussite de ces profils. C’est pourquoi il est crucial de vérifier la représentativité des données, de tester les modèles sur des sous‑populations et de corriger les biais identifiés.

Lexique

-

Analytique prédictive : branche de l’analyse de données qui utilise l’historique pour prédire l’avenir.

-

Classification / clustering : technique permettant de regrouper des éléments similaires en catégories homogènes, souvent sans connaissance préalable du nombre exact de groupes.

-

Anomalie : observation qui dévie du comportement attendu et peut signaler une fraude ou un incident.

-

Thématique (thematic analysis) : méthode d’analyse qualitative qui identifie des thèmes récurrents dans des données textuelles.

-

Corrélation : mesure statistique indiquant l’association entre deux variables ; elle ne prouve pas la causalité.

-

Pattern recognition : domaine de l’apprentissage automatique qui repère des motifs répétitifs dans des données et les utilise pour classer ou prédire.